想成为一名数据专家,意味着你不仅要掌握分析工具,更要建立系统化的数据思维,并能在业务中创造实际价值。这是一个需要耐心和持续投入的过程。整理了一份为期三年的参考路线图,它将基础构建、专业深化与价值输出分开,你可以根据自己的节奏灵活调整。

第一阶段:地基构建(第1年)——建立扎实的技术与思维基础。这个阶段的目标是从“零”到能够独立完成一个完整的数据分析项目。核心技能:SQL (重中之重):这是数据领域的通用语言。结构化查询语言(Structured Query Language)简称SQL,是一种特殊目的的编程语言,是一种数据库查询和程序设计语言,用于存取数据以及查询、更新和管理关系数据库系统;同时也是数据库脚本文件的扩展名。你需要达到熟练运用窗口函数、复杂查询、查询优化的水平,确保能从数据库中高效、准确地提取任何你需要的数据。

Python (或 R):Python 是一种高级、通用、解释型的编程语言,支持面向对象、过程式、函数式等多种编程范式。它的语法简洁,可读性强,常被称为“胶水语言”,能方便地将 C/C++ 等其他语言写的模块拼在一起使用。重点掌握 Pandas、NumPy 等数据分析库,以及 Matplotlib、Seaborn 等可视化库。目标是能用代码完成数据清洗、处理和探索性分析。统计学基础:理解描述性统计、概率分布、假设检验(T检验、卡方检验)、相关性与回归分析等核心概念,这是你未来解读数据、避免被“数字误导”的根本。可视化与讲故事:掌握 Tableau、Power BI 或 Superset 等工具,学会制作清晰且有洞察的仪表板。好的可视化能让你的分析结果一目了然。

学习建议:结构化课程:建议选择一门包含项目实战的系统课程(如谷歌数据分析证书、或相关大学的在线微学位),跟着框架学习能少走弯路。坚持实践:在 LeetCode 上持续练习 SQL 直到中等难度题目无压力;在 Kaggle 上找感兴趣的数据集,用 Python 完成从“数据清洗-->分析--> 可视化”的完整流程,并发布你的第一份分析报告。年度目标:建立一个包含3个完整项目的线上作品集(GitHub),并确保你能清晰地解释每个项目的业务背景、技术选型和最终洞察。

第二阶段:专业深化(第2年)——选择赛道并深入核心。这一年,你需要根据兴趣选择一个细分方向,并开始触及更复杂的工程或建模问题。选择方向:数据分析师/科学家(分析向):侧重通过数据和AB测试等为业务决策提供支持,需要深耕高级统计学(如因果推断、实验设计)、机器学习(Scikit-learn,重点掌握分类、回归、聚类模型及评估方法)以及特定领域知识(如电商的漏斗分析、金融的风控指标)。数据工程师(工程向):侧重搭建稳定、高效的数据管道,需要学习数据仓库建模理论(如Kimball维度建模)、大数据框架(Spark、Flink)、工作流调度工具(Airflow)以及云平台服务(AWS/Azure/GCP的相关数据服务)。

学习建议:完成一个端到端的复杂项目:例如“构建一个实时数据管道并进行可视化展示”,或“参与一个Kaggle竞赛并进入前10%”。这个项目应该涵盖从数据采集、处理、存储到分析或建模的全流程。理解生产环境:学习Docker、Git协作等工程化工具,了解你的代码或模型是如何部署上线、服务于真实用户的。年度目标:明确你的细分方向,并在该方向上完成至少 1个具有复杂度的综合项目,使其成为你简历上的核心亮点。

第三阶段:价值输出(第3年)——从执行者到影响者。此时,你的技术已经相对成熟,重点将转向解决模糊问题、驱动决策和扩大影响力。核心能力:解决模糊问题:学会将模糊的业务痛点(如“用户留存下降了”)拆解为清晰的数据问题(“哪个渠道、哪个时点的用户留存下降了?可能原因是什么?”),并独立设计完整的分析框架。驱动决策与沟通:锻炼将复杂的技术发现,转化为业务方听得懂、能执行的商业语言的能力,并学会用数据推动项目、争取资源。系统设计与架构:开始关注整个数据平台或数据产品的架构,思考如何提升数据质量、保障稳定性、降低计算成本。

学习建议:获取真实经验:尝试在公司内部主导一个跨部门的数据项目,或在开源社区中为知名数据项目贡献代码,这能让你接触到真实世界的约束(如资源、时间、协作)。建立行业视野:通过阅读顶级科技公司的技术博客,参加行业会议(如Data + AI Summit),了解前沿趋势(如LLM应用、数据网格/数据编织),思考这些技术如何与你的业务结合。年度目标:成为团队中在某个领域(如AB测试、用户增长分析、实时计算)公认的专家,并具备独立主导和交付复杂数据项目的能力。

关于学习形式,三年间建议组合使用以下方式:系统性课程 (20%):初期用来建立知识框架。阅读 (20%):精读《SQL必知必会》《利用Python进行数据分析》等经典书,并持续阅读行业技术博客。实践项目 (50%):这是成长的核心。从Kaggle练习到个人项目,再到工作中的真实任务,学以致用才能内化能力。社交与指导 (10%):参与数据社群,向比你资深的人请教,寻找一位导师能帮你避免很多弯路。数据领域变化很快,这个计划的关键不是按部就班地完成,而是在实践中不断迭代。每完成一个项目,都可以回头审视自己的知识结构,把不牢固的地方补上,再向前推进。

将阅读和写作结合起来,是一个极佳的内化路径:阅读是输入,帮你建立体系;写作是输出,帮你检验并巩固认知。结合之前提到的三年路线图,梳理了一份从基础到进阶的阅读书单,以及通过写作来提升自己的具体思路。一、阅读书单:构建从技术到思维的体系。建议按阶段阅读,不必求多,每本读透更重要。第一阶段:地基构建期。这个阶段的目标是建立技术基础和数据思维。技术类:《SQL必知必会》:SQL入门经典,简明扼要,适合快速上手。配合LeetCode练习效果更佳。《利用Python进行数据分析》:Pandas库作者亲笔,是数据分析的“操作手册”。建议边读边敲代码,是第一阶段最值得啃透的一本。思维与通识类:《深入浅出数据分析》:用生动案例讲解分析流程与基本统计思维,适合零基础建立全景图。《精益数据分析》:核心是讲如何找到“第一关键指标”,帮你理解数据如何与业务目标结合,避免陷入“虚荣指标”的陷阱。

第二阶段:专业深化期。这个阶段的目标是深入专业方向,并理解数据系统的复杂性。分析/算法方向:《机器学习实战:基于Scikit-Learn、Keras和TensorFlow》:一本非常实战的机器学习书,理论与代码结合得很好,能帮你建立模型应用的完整框架。《面向数据科学家的实用统计学》:衔接统计学与数据科学,重点讲解如何用统计思维(如分布、抽样、因果推断)解决实际问题,比纯理论书更适合数据从业者。工程方向:《数据密集型应用系统设计》(简称DDIA):数据工程师的必读经典。它不讲具体工具,而是深入剖析分布式系统、存储、计算背后的底层原理。读完能让你对各种数据库、大数据框架有更本质的理解。思维进阶:《思考,快与慢》:帮助理解人类认知偏误,这对设计实验、解读数据、避免被数据误导至关重要。

第三阶段:价值输出期。这个阶段的目标是提升架构视野与影响力。架构与组织:《数据仓库工具箱:维度建模权威指南》:Kimball大师的著作,数据建模的“圣经”。无论你是否直接做数仓,理解这套方法论都有助于你高效地组织和使用数据。《数据大师》:通过多个大厂案例,讲述数据团队如何与组织协作、驱动决策,帮你从“技术执行者”视角提升到“业务影响者”视角。

二、写作提升:从笔记到见解。写作的目的不是成为博主,而是强迫自己将模糊的理解,转化为清晰、结构化的表达。这个过程能帮你发现知识盲点。第一阶段:写给自己——技术笔记与项目复盘。这个阶段的目标是记录与沉淀,不用追求发布,重点是让自己能“复述”出来。写什么:技术备忘:用自己的话重述复杂知识点。例如“SQL窗口函数:什么时候用ROW_NUMBER还是RANK?”。项目复盘:完成一个项目后,按“背景 -> 目标 -> 过程 -> 结果 -> 未解问题”的结构记录下来。尤其是“遇到的坑和解决方法”,非常有价值。价值:这些记录会成为你的个人知识库,也是未来面试、述职时宝贵的素材。

第二阶段:写给同行——技术博客与概念解读。当你有了一定积累,可以尝试公开发布,建立个人技术品牌。写什么:技术教程:把一个复杂概念讲清楚。例如“图解Spark Shuffle原理”,试着用通俗的语言和图表来解释,是检验你是否真正理解的好方法。工具对比与选型:例如“Pandas vs SQL:什么场景下该用谁?”这类分析能体现你对技术栈的权衡思考。Kaggle方案复现:解读一个优秀竞赛方案,分析作者为什么这么做,这是学习高阶技巧的捷径。发布平台:可以考虑知乎专栏、掘金、个人博客 或 微信公众号。

第三阶段:写给行业——深度分析与价值洞察。这个阶段的目标是展现你的业务理解力和数据领导力。写什么:深度分析报告:将工作中的一次深入分析(如“用户流失归因分析”)抽象成方法论,脱敏后分享。重点展示分析框架和业务洞察,而非技术细节。行业思考:结合行业动态,分享你对某个趋势的看法。例如“大模型时代,数据专家的核心价值会转移向哪里?”书籍书评/读后感:对经典著作结合自己的实践经验进行解读,是沉淀自己、启发他人的好方式。最后,想提醒一点:不用等“完全准备好”再开始写作。从第一阶段起,就可以尝试把学习笔记整理得清晰、有条理一些。写作本身就是思考的过程。

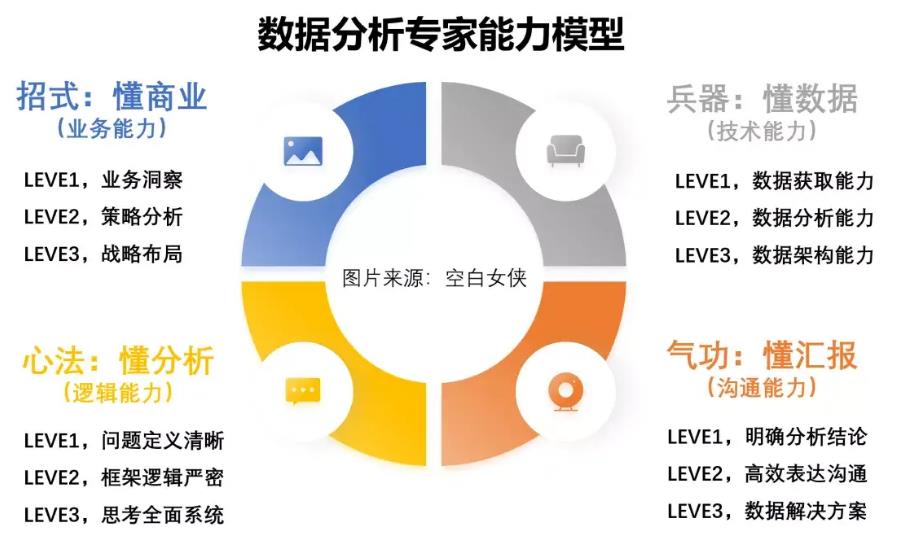

如何帮助企业进行数据分析?技术是手段,解决业务问题才是目的。从学习技能到为企业创造价值,关键在于完成思维转变——从“我掌握哪些工具”转向“我能用数据解决什么业务问题”。帮企业做数据分析,通常遵循一个核心流程,梳理为五个步骤:

1.理解业务,定义问题。这是最关键也最容易被忽视的一步。如果问题定义错了,后续分析再精彩也毫无价值。核心原则:你需要与业务方深入沟通,把“业务痛点”转化为“数据问题”。业务方可能会说“最近用户流失很严重”,你的工作就是厘清:怎么定义“流失”?“最近”是哪个时间段?严重到什么程度?最终将模糊描述转化为可量化、可操作的命题,如“过去30天内,某渠道用户的7日留存率下降了15%,请定位下降原因”。建立框架:可以借助OSM模型(目标-策略-度量)和UJM模型(用户旅程地图),将宏大的业务目标拆解到具体的、可分析的数据指标上。

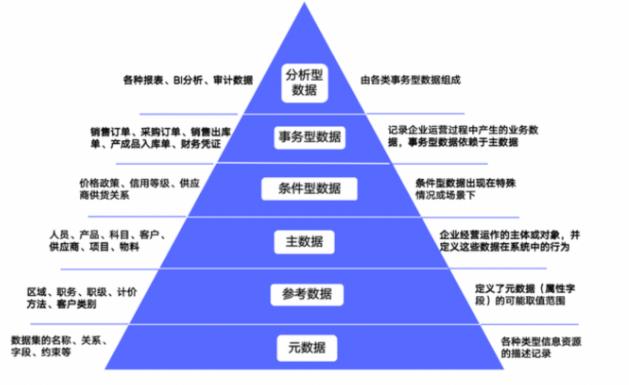

2.准备数据,保障质量。明确问题后,需要获取数据并确保其质量。取数与清洗:用SQL从数据仓库提取数据。这个阶段80%的工作可能都在清洗——处理缺失值、异常值,统一字段格式,关联所需表格等。构建指标:根据分析目标,计算核心指标。比如分析流失,需要计算“最后活跃时间”、“过去7天访问次数”等衍生字段。

3.开展分析,发现洞察。这是技术综合运用的阶段,核心是通过对比和拆解,从数据中定位到具体业务抓手。明确方法:根据问题选择方法。比如分析“某功能上线是否有效”可以用AB测试;定位指标波动原因可以用维度下钻(按渠道、地区、版本拆解)和漏斗分析;预测用户行为则用机器学习模型。核心技巧:不断追问“然后呢?” 不要只停留在“发现A渠道用户留存低”,而要深挖“A渠道用户留存低,是因为他们在激活环节没有完成关键行为,所以我们建议优化该渠道的落地页引导。”

4.呈现结论,讲好故事。分析再深入,如果无法说服他人,价值就等于零。选对形式:专题分析用PPT或文档,以“总-分-总”结构讲清背景、结论和建议;常规监控则搭建仪表板,让业务方能自助查看关键指标。讲清逻辑:遵循金字塔原理,结论先行。让受众在30秒内抓住核心发现和行动建议。

5. 推动落地,评估价值。数据分析的最终价值在于决策是否因此改变,业务是否因此受益。输出行动建议:结论要转化为具体的业务动作。例如“建议运营团队针对高价值但活跃度下降的用户,在下周二前发放定向优惠券。”建立闭环:方案上线后,你的工作并没有结束。要持续跟踪效果,评估是否达到预期,形成“分析--> 建议--> 落地--> 评估--> 迭代”的完整闭环。

如果将这五个步骤,对应到你三年行动计划的不同阶段,侧重点会有所不同:第一年(执行者):重点是高质量地完成步骤1-3。当接到明确的需求(如“帮我拉一下上周的销售数据”)时,你能主动理解背景,交付干净准确的数据和基础分析。第二年(思考者):重点是主导步骤1-4。你开始能主动发现业务问题,独立完成从取数到形成完整分析报告的全过程,并能用清晰的逻辑向业务方讲述数据故事。第三年(影响者):重点是贯穿步骤1-5,驱动决策。你不仅能解决单个问题,还能设计核心指标体系,推动数据产品化(如自助仪表板),并持续追踪自己建议的落地效果,成为业务团队信赖的数据合伙人。

总的来说,帮企业做数据分析的核心,就是从交付“数据” 升级为交付“决策”。如果你现在已经开始接触一些实际业务场景,可以想想最近遇到的一个业务问题,试着按照“定义问题---> 拆解思路---> 所需数据”这个框架梳理一下。